Злоумышленники постоянно изобретают новые способы проведения атак, используют новые технологии, и в последнее время всё чаще используют инструменты, в составе которых применяются модели искусственного интеллекта.

Однако, наряду с увеличением использования современных технологий в неправомерных целях, увеличивается количество способов защиты и борьбы с киберпреступностью при использовании этих технологий. В статье расскажем, как искусственный интеллект помогает в борьбе с киберпреступностью.

Почему нейросети опасны в руках мошенников

Мошенники создают достаточно правдоподобную цифровую копию человека: заводят от его имени аккаунты в соцсетях и мессенджерах, подписываются на похожие группы, копируют манеру общения, делают замену голоса и лица во время видеозвонка.

Втеревшись в доверие с поддельным цифровым профилем, злоумышленники пытаются выманить деньги, пароли от рабочих сервисов. Например, рассылают сообщения в телеграм от лица руководителя, просят перейти по ссылке и заполнить анкету или предупреждают о звонке представителя ФСБ.

Используют нейросети для проведения кибератак, собирая с его помощью информацию об инфраструктуре компании, а затем разрабатывая индивидуальный план атаки.

Обращаются к ИИ для разработки вредоносного ПО — технологии машинного обучения позволяют ему действовать в замкнутой инфраструктуре без соединения с управляющим сервером.

Если в информационной системе компании есть слабые места, злоумышленники могут получить доступ к файлам. Хакеры могут целенаправленно атаковать компании для кражи данных, саботажа или шпионажа. Обычно киберпреступников интересуют персональные данные клиентов, финансовая информация и интеллектуальная собственность — они похищают базы данных или уникальные разработки для продажи.

Как минимум это может привести к репутационному ущербу и оттоку клиентов из‑за потери доверия к бренду. А если злоумышленники внедрили вредоносное ПО, оно способно парализовать работу компании — например, когда утерян доступ к критически важным системам и данным.

На восстановление систем и данных, штрафы за нарушение законов о защите персональных данных и компенсации придётся направить внушительные суммы, особенно если клиенты подадут иски в суд. Убытки могут быть настолько велики, что приведут к банкротству.

ИИ на стороне добра

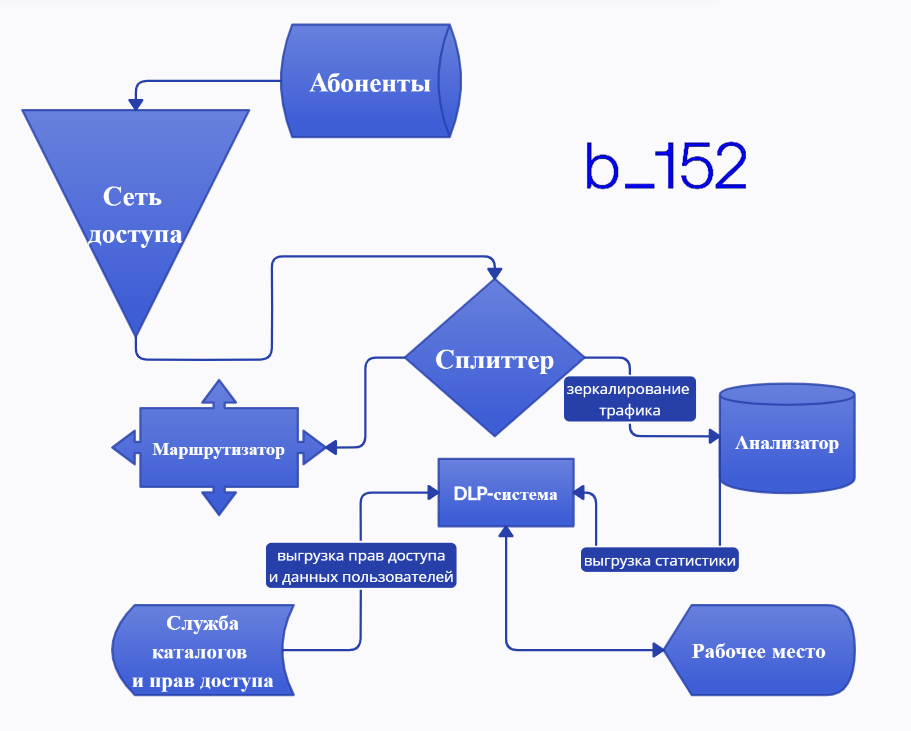

Специалисты по информационной безопасности в защитных решениях достаточно широко используют системы на базе моделей искусственного интеллекта. Например, DLP системы, предназначенные для предотвращения утечек конфиденциальной информации, ранее использовали такие методы:

- проверка документов на наличие определенных “маркеров конфиденциальности”;

- подстановка шаблонов;

- применение регулярных выражений;

- создание цифровых отпечатков документа.

За счёт использования технологий искусственного интеллекта они продвинулись далеко вперёд. Методы обработки естественного языка (NLP) и машинного обучения (ML) позволяют обучить DLP систему распознавать и классифицировать обращающиеся в контуре компании документы для более точной фильтрации. NLP понимает контекст документа, даже если выглядит неформально и у него нет меток конфиденциальности.

В антивирусах ИИ повышает скорость обнаружения нового вредоносного ПО. Его алгоритмы анализируют сведения об обнаруженных ранее угрозах, прогнозируют новые атаки и предлагают методы обнаружения вредоносных файлов или программ, а также защиты от них.

Многие даже не подозревают, что имеют дело с системами, в которых применяются технологии искусственного интеллекта. Например, когда индивидуальный предприниматель переводит деньги через банковское приложение, антифрод‑системы анализируют подозрительные операции на предмет наличия мошеннических действий. В них встроен модуль машинного обучения, который на основе статистических данных составляет образ типичных действий клиента: как часто и какие суммы обычно переводит клиент, где он находится, сим‑картой какого оператора пользуется, как часто он открывает приложение. ИИ распознает даже то, какой рукой человек держит телефон, как двигает мышкой, нажимает на кнопки или клавиши. Если антифрод‑систем видит, что действия не характерны для пользователя, то маркирует транзакцию как рискованную.

Вспомните, было ли у вас такое, что банк блокирует денежный перевод новым контрагентам? Это происходит потому, что ИИ банка проверяет транзакцию на наличие признаков мошеннических операций, их перечень утвержён ЦБ РФ. Если есть совпадения, операции будет присвоен статус сомнительной.

ИИ борется с фишингом

Фишинг — это обман пользователей для получения логинов, паролей и другой конфиденциальной информации. Обычно злоумышленники маскируются под легитимные организации и отправляют сообщения с ссылкой на поддельный сайт. Например, когда сотрудник компании вводит свои данные, программа их считывает, после чего они становятся доступны мошенникам, что повышает риск несанкционированного доступа к корпоративным системам.

Для защиты пользователей компании используют ИИ, который распознаёт копии изображений настоящего сайта на чужих ресурсах и отправляет информацию о них на сервер, поэтому злоумышленники не могут точно скопировать дизайн, а делают его максимально похожим на оригинал.

В сервисах VK искусственный интеллект скрывает недружелюбные комментарии, предупреждает о подозрительных собеседниках в мессенджере и нежелательных телефонных звонках в мобильном приложении, что помогает компаниям взаимодействовать с аудиторией в соцсетях.

ИИ анализирует огромные объёмы данных из миллионов источников, включая социальные сети и даркнет, чтобы изучить случаи нарушения безопасности и выявить зарождающиеся тенденции в сфере киберугроз. Алгоритмы постоянно обновляются по мере появления новых угроз, поэтому компании, которые используют ИИ для защиты информации и персональных данных, всегда остаются на шаг впереди злоумышленников.

О чем хотите спросить автора статьи? Пишите вопросы в комментариях.