Крупные интернет‑магазины сталкиваются с проблемой масштаба: SEO‑команда физически не успевает создавать достаточно теговых для миллионов товаров. Ручная работа дает 30 новых страниц в месяц, когда бизнесу нужно 100–500. Результат предсказуем — сорванные сроки, растущие затраты и(или) низкое качество.

Перед нами стояла задача собрать семантику для 500 000 кластеров за полгода. Классический подход показал свою несостоятельность уже через три месяца. Пришлось искать решение на стыке SEO‑экспертизы и возможностей нейросетей — и мы его нашли.

Начнем издалека: зачем вообще заниматься проработкой сайта

Проработанная структура сайта напрямую влияет на финансовые показатели бизнеса. Широкий ассортимент охватывает больше поисковых запросов, отсутствие дублей страниц улучшает позиции в выдаче, удобная навигация повышает конверсию. Все это способствует росту органического трафика и выручки.

Но при работе с крупными проектами возникают системные сложности: неполный сбор семантики, отсутствие сегментации по намерениям пользователей, нелогичная структура с пересечениями запросов между разделами. Добавьте необходимость в большой команде и ограничения стандартных инструментов — и ручное масштабирование становится проблемой.

Мы столкнулись с тем же на одном из проектов. Рассказываем, что пробовали и к чему пришли.

Рассылка: как вести бизнес в России

Пять полезных писем пришлем сразу после подписки. В них — бизнес‑идеи, готовые промпты для нейросетей, советы, как выбрать налоговый режим и получать пассивный доход

Глава первая: 10% работы за три месяца

К нам обратился клиент из e‑com — проект стартовал так:

Клиент пришел с задачей сделать теговые: за полгода собрать семантику для 500 000 кластеров, построить структуру, прописать заголовки и анкоры, типизировать страницы.

Уже тогда мы держали в голове два формата:

- ИИ‑генерация без семантики — быстро, но с риском наплодить малополезного контента;

- наполнение страниц с ручной проработкой семантики — ощутимо дольше (и дороже), но качественнее.

Решили начать с проверенного второго варианта. Шесть специалистов собирали маски и минус‑фразы, кластеризовали запросы, вручную проводили чистку и рекластеризацию.

И выявили такие проблемы:

- сервис Key.so не может отдать сразу все запросы по такому объёму;

- Excel не обрабатывает больше 1 млн строк;

- процесс растягивают промежуточные задачи;

- усталость команды нарастает, и падает качество.

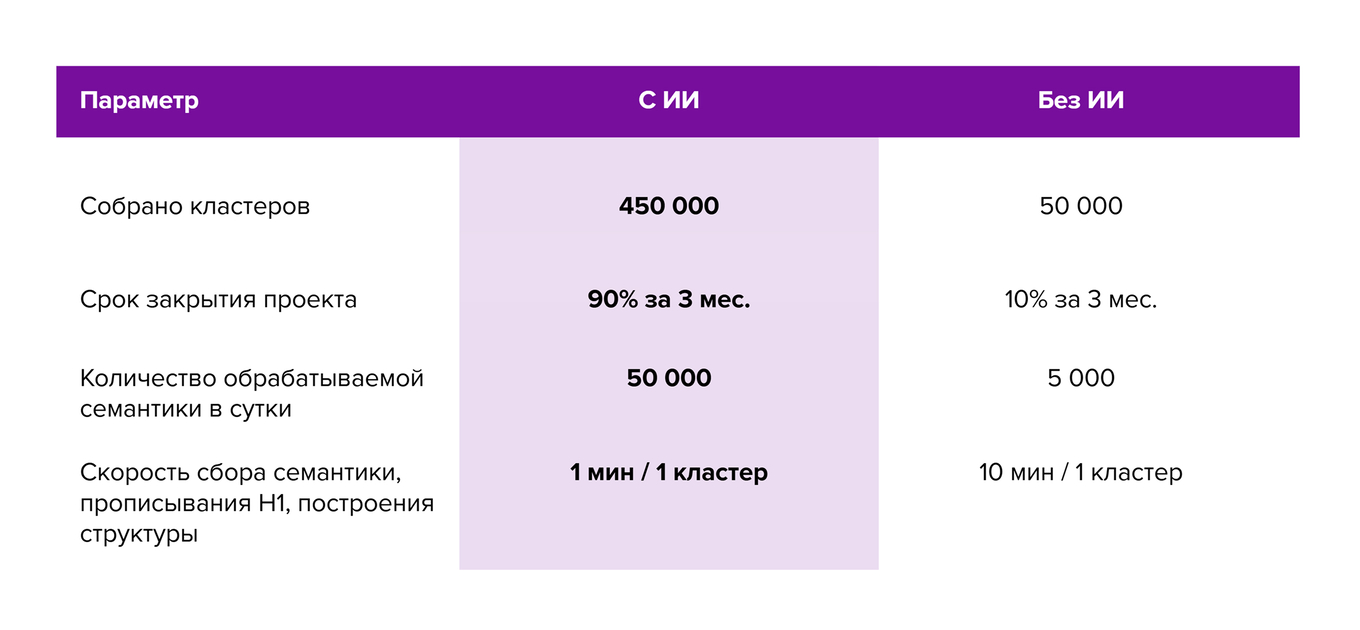

Через три месяца выполнили только 10% объема. При этом рабочий день сотрудников растянулся до 15 часов, а рентабельность проекта упала до -60%.

Пора было что‑то менять.

Глава вторая: автоматизация и эксперименты

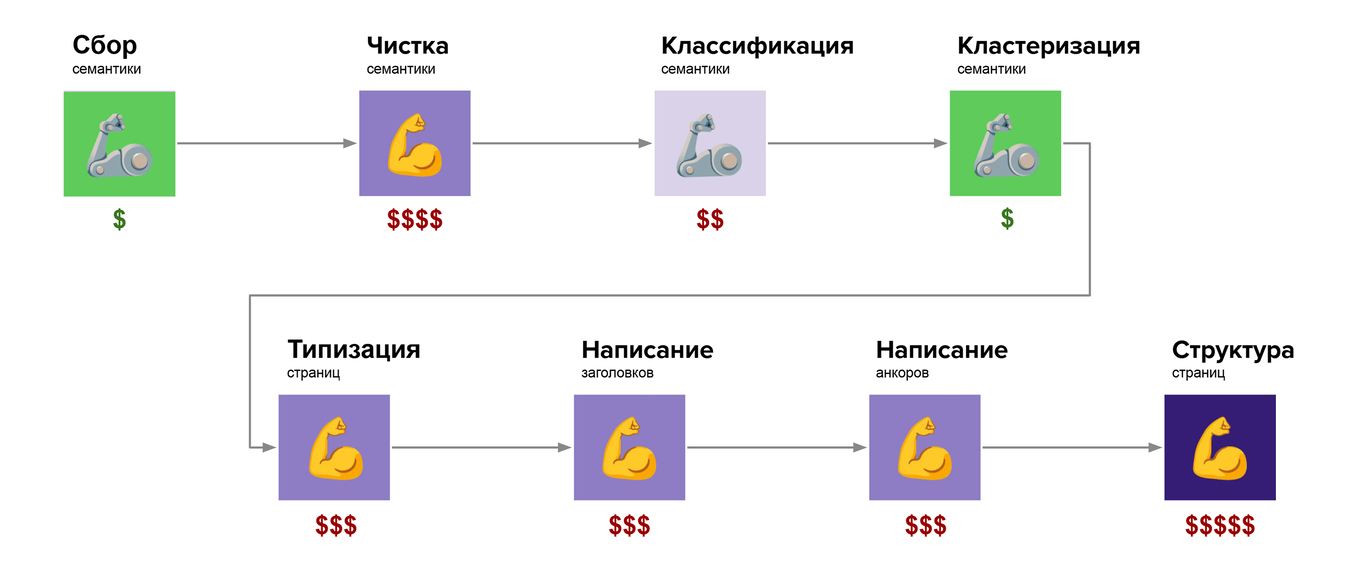

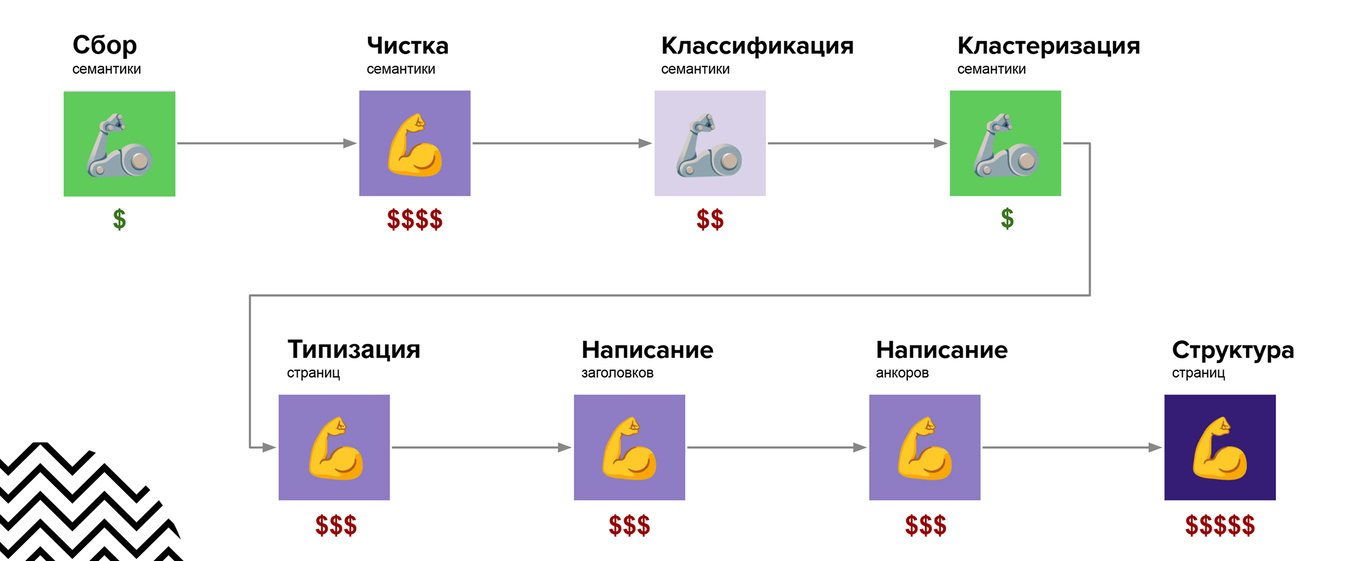

До дедлайна оставалось три месяца — ровно столько, сколько мы уже потратили на 10% работы. Проанализировали технический процесс и увидели, какие этапы обходятся нам дороже всего.

Взяли курс на автоматизацию и сделали следующее.

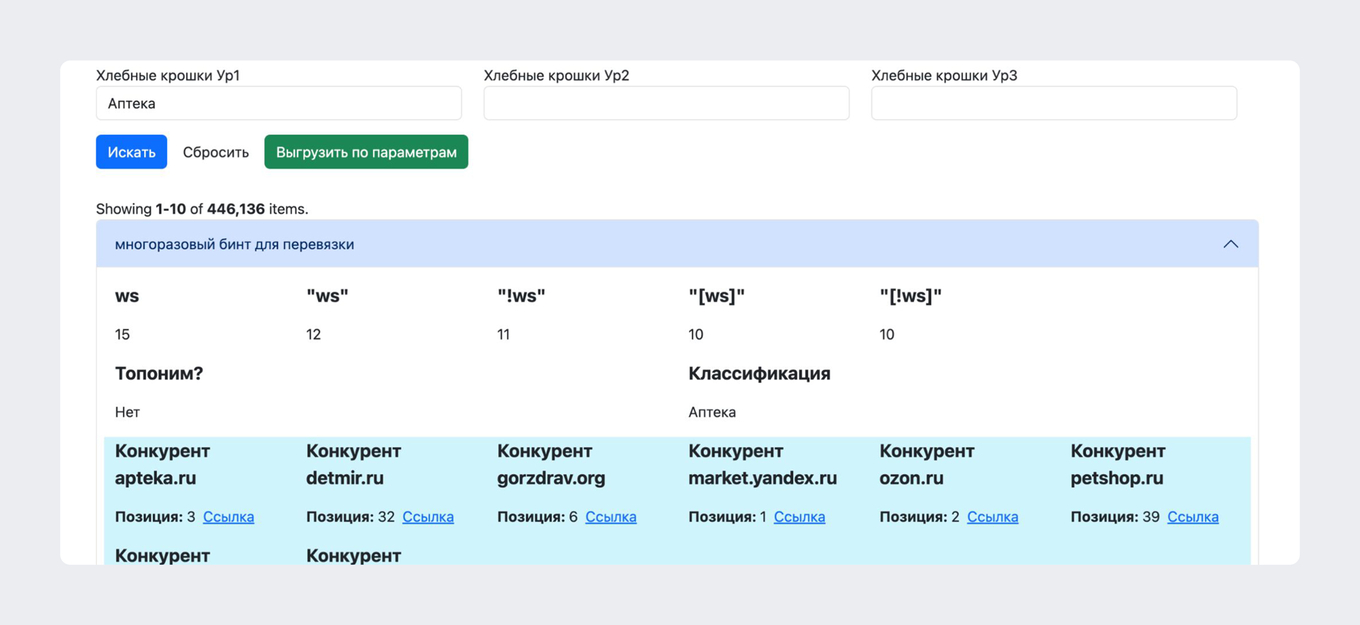

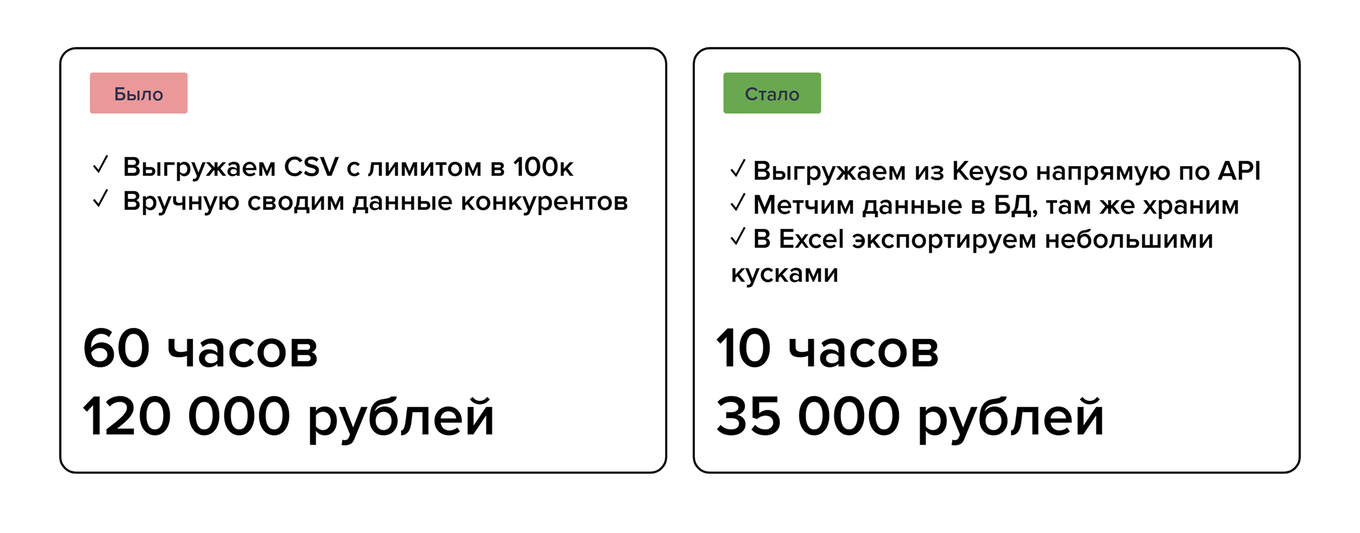

Шаг 1. Частично заменили Excel на БД. Так решили проблему с обработкой больших объёмов. Начали выгружать запросы из Key.so по API в базу данных. Excel из уравнения не выкинули — экспортировали результаты в таблицу небольшими кусками. И дальше работали в удобном формате.

С такой комбинацией инструментов смогли обрабатывать миллионы строк без технических ограничений. И втрое снизили расходы на этом этапе.

Наша схема с предыдущего этапа стала выглядеть бодрее:

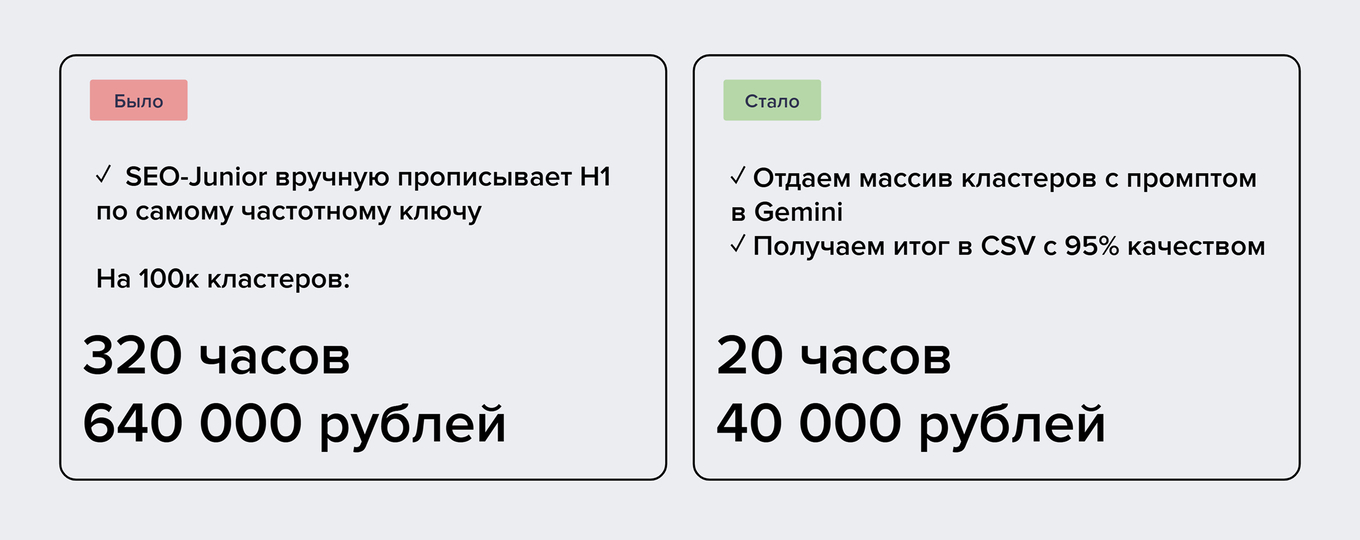

Шаг 2. Протестировали ИИ на заголовках. Формирование H1 вручную — простая, но крайне времязатратная задача. Идеальное сочетание, которое можно переложить на нейросети. Первые тесты через веб‑интерфейс ChatGPT показали две проблемы:

- За один запрос можно обработать максимум 200–300 строк, а это дополнительные трудозатраты на обращение к нейросети за каждым таким кусочком.

- Модель ChatGPT‑4 не всегда следовала техническому заданию и теряла часть данных.

Задумались, как это можно решить — много экспериментировали и нашли способ.

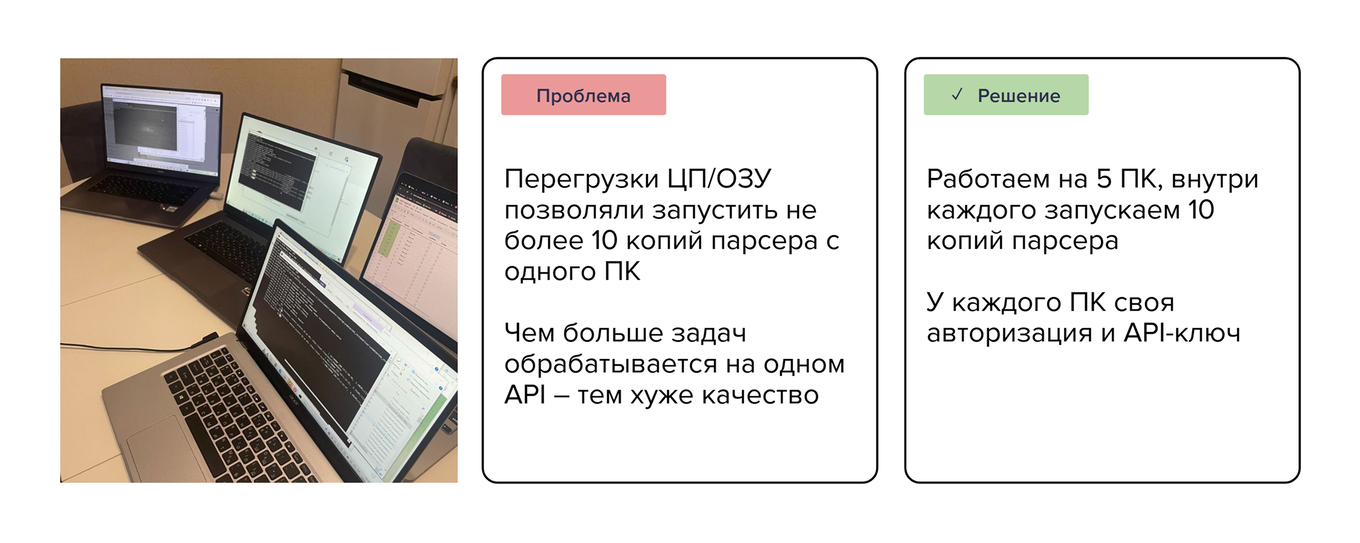

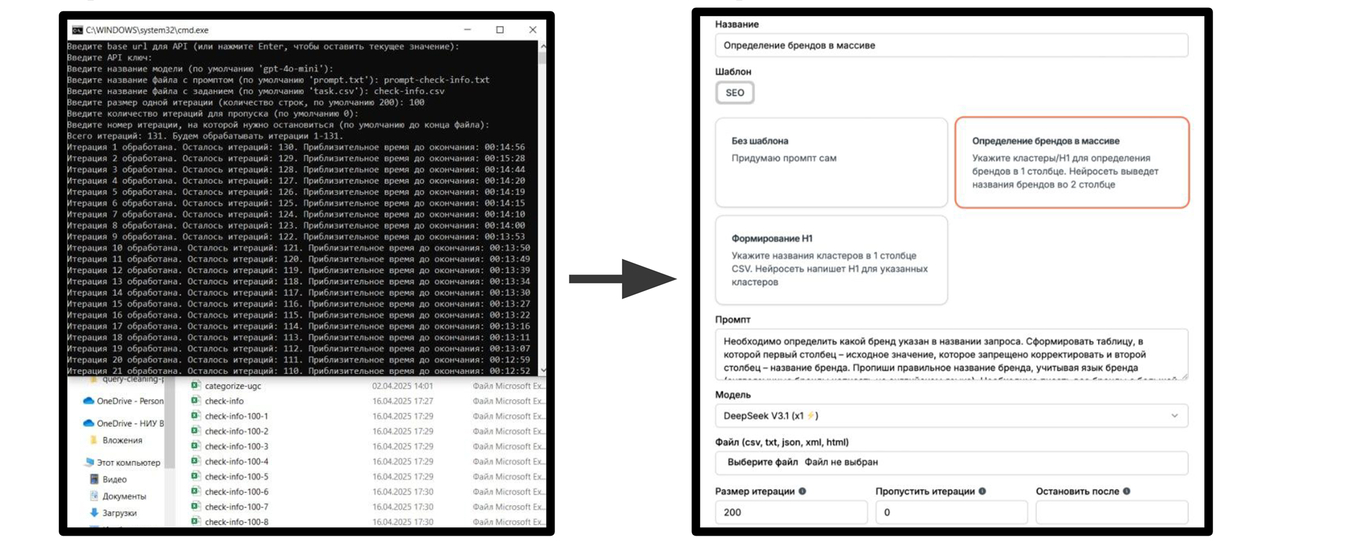

Шаг 3. Повысили скорость и качество. Для ускорения создали технологический стек: Python + API + AI + CSV. Миллионы строк разбивали на фрагменты по 200–300, отправляли в нейросеть через API с промптом, затем объединяли готовые части на бэкенде.

И про интерфейс не забыли:

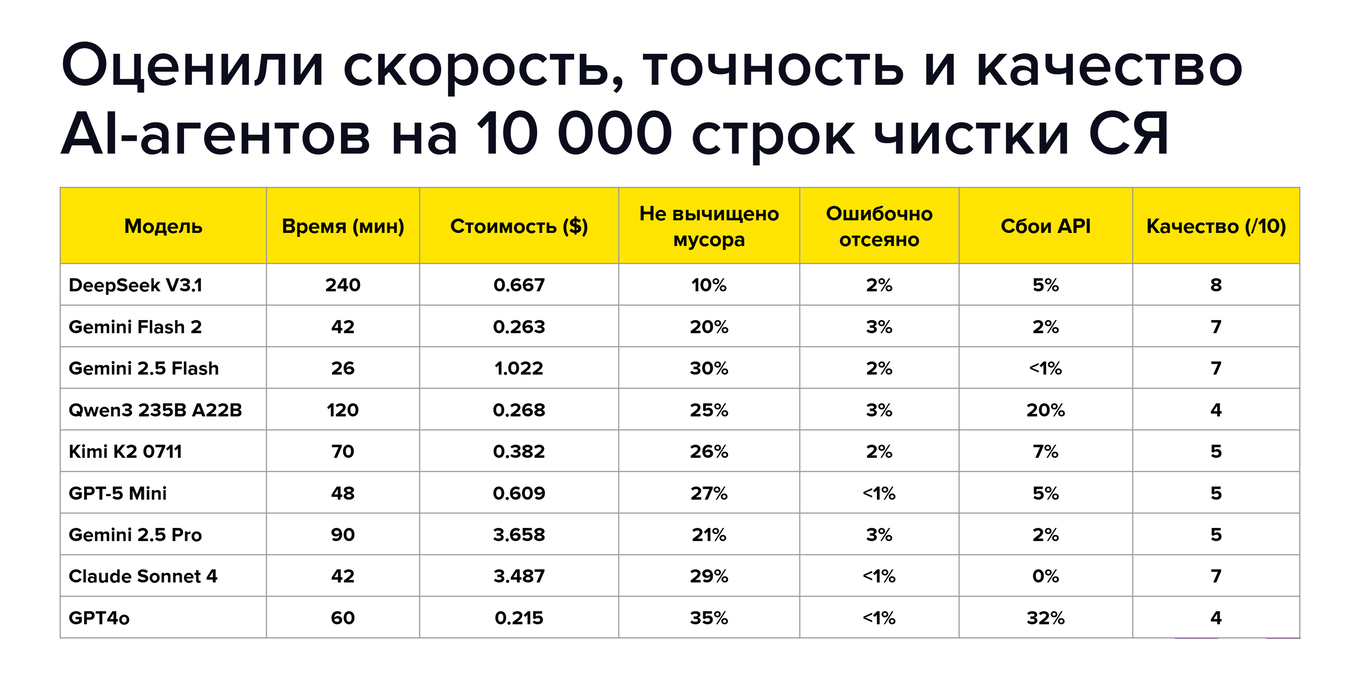

Попробовали разные нейросети — самостоятельно и комбинированно. Выбрали вариант с большим контекстным окном — Gemini 2.0, позже перешли на Gemini 2.5 и DeepSeek V3.1. Настроили важные параметры вроде temperature, tор‑р / tор‑к, frequency/presence penalty, чтобы модели точнее следовали заданию.

Лучшие варианты для нашей задачи на этом проекте определяли по соотношению «скорость‑стоимость‑качество».

Шаг 4. Отладили процесс. Каждую генерацию сравнивали с результатами работы SEO‑специалистов. Находили и классифицировали ошибки, дорабатывали промпты — и так циклично, пока не вышли на стабильное качество.

В этом блоке экономия получилась еще заметнее: с нейросетями сократили расходы на создание H1 в 16 раз.

Глава третья: масштабирование

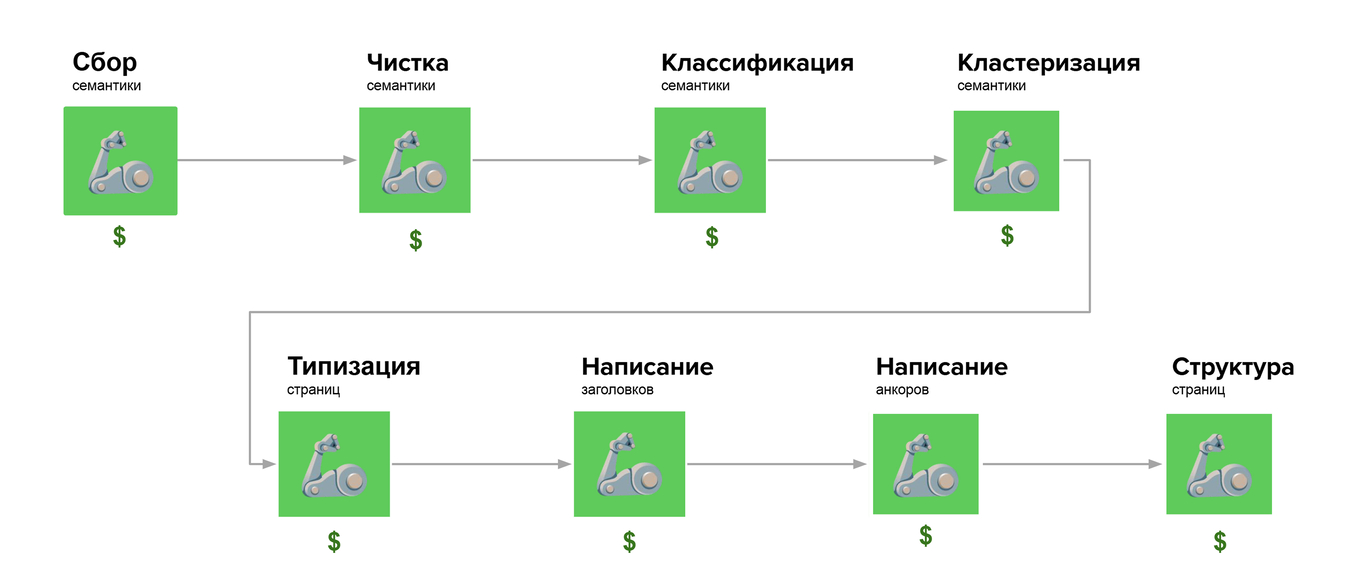

После успешной отладки на заголовках расширили применение ИИ. Смогли внедрить нейросети в следующие этапы и подзадачи:

- чистка семантики — автоматическое удаление нерелевантных запросов;

- классификация — разделение по намерениям и типам запросов;

- определение геолокации и брендов — маркировка специфических запросов;

- написание метатегов и анкоров — массовое создание по заданным правилам;

- привязка и описания товаров — генерация текстов для миллионов SKU;

- построение структуры — формирование древовидной иерархии разделов.

И схема процесса стала выглядеть совсем хорошо.

Когда большую часть рутины переложили на ИИ, справились силами шести специалистов: они управляли процессами и контролировали качество.

Результаты проекта

После ускорения смогли:

- ежедневно обрабатывать по 50 000 запросов (10 000 кластеров);

- создать 500 000 новых теговых страниц;

- приблизить завершение работ на два года;

- сэкономить 8 миллионов рублей на команде.

Задачу клиента, которая в начале казалась невыполнимой, завершили полностью в установленный дедлайн.

Нюансы автоматизации с нашими выводами

Обработка больших данных. Стандартные инструменты не справляются с миллионами запросов. Решение — переход на базы данных и работа через API.

Выбор инструментов. Разные модели показывают разное соотношение скорости, стоимости и качества. Потребовалось провести детальное сравнительное тестирование на реальных данных, чтобы найти подходящий вариант.

Качество генераций. Нейросети на старте часто отходили от технического задания. Нужно было настраивать параметры, многократно дорабатывать промпты.

Важность экспертизы. Нейросети требуют регулярной проверки результатов и корректировки подходов. Без понимания SEO‑логики они просто генерируют большой объем контента с ошибками.

Искусственный интеллект помогает автоматизировать SEO и масштабироваться без кратного увеличения команды. И это работает не только в e‑commerce. Нейросети будут полезны и на других проектах с большими объемами контента: в B2C‑сервисах, СМИ, крупных блогах.

Ключевое условие успеха — сочетание технологий и экспертизы. ИИ берет на себя рутину, люди отвечают за стратегию и контроль качества. При правильном подходе экономия на команде исчисляется миллионами рублей, а работа ускоряется в разы.

Что учесть на старте и в процессе

Оцените масштаб проекта. Автоматизация через нейросети экономически оправдана для проектов от 1000 кластеров. На небольших объёмах разница в затратах между ручной работой и ИИ‑подходом минимальна. Чем крупнее проект, тем выше экономия.

Выбирайте модель под конкретные задачи. Чтобы сэкономить ресурсы и не уронить качество, учитывайте эти факторы:

- Качество генерируемого контента. От этого параметра зависит количество ручных корректировок. Чем лучше результат на выходе, тем меньше времени уходит на ручную доработку.

- Производительность при больших больших объемах. Важно наличие пакетной обработки данных (batch‑запросы), ограничения по количеству токенов и быстродействие системы при массовой генерации материалов.

- Надежность API и качество технической документации. Без этих составляющих автоматизация теряет эффективность и превращается в работу вручную.

- Поддержка разных языков. Критична способность обрабатывать запросы на русском языке, а также смешанный англо‑русский контент для SEO‑оптимизации.

- Экономическая целесообразность и возможности роста. Тарифы напрямую влияют на работу с масштабными задачами. При миллионах обращений даже небольшая разница в $0,1 за 1000 токенов оборачивается значительным увеличением бюджета.

Сохраняйте баланс между ИИ и людьми. Нейросети эффективны в рутине, но не заменяют опытную команду и не мыслят стратегически. Вам понадобятся специалисты, которые выберут и настроят модель под задачу, разработают и доработают промпты, будут проверять генерации, выявлять и исправлять системные ошибки.

Начинайте с малого. Не автоматизируйте всё сразу. Выберите одну задачу, протестируйте решение, отладьте. Только после получения стабильного результата масштабируйте подход на другие направления.

Закладывайте время на внедрение. Разработка, тестирование и отладка автоматизированных процессов не происходят мгновенно. Планируйте переход заранее, чтобы не оказаться в эпицентре горящих дедлайнов.